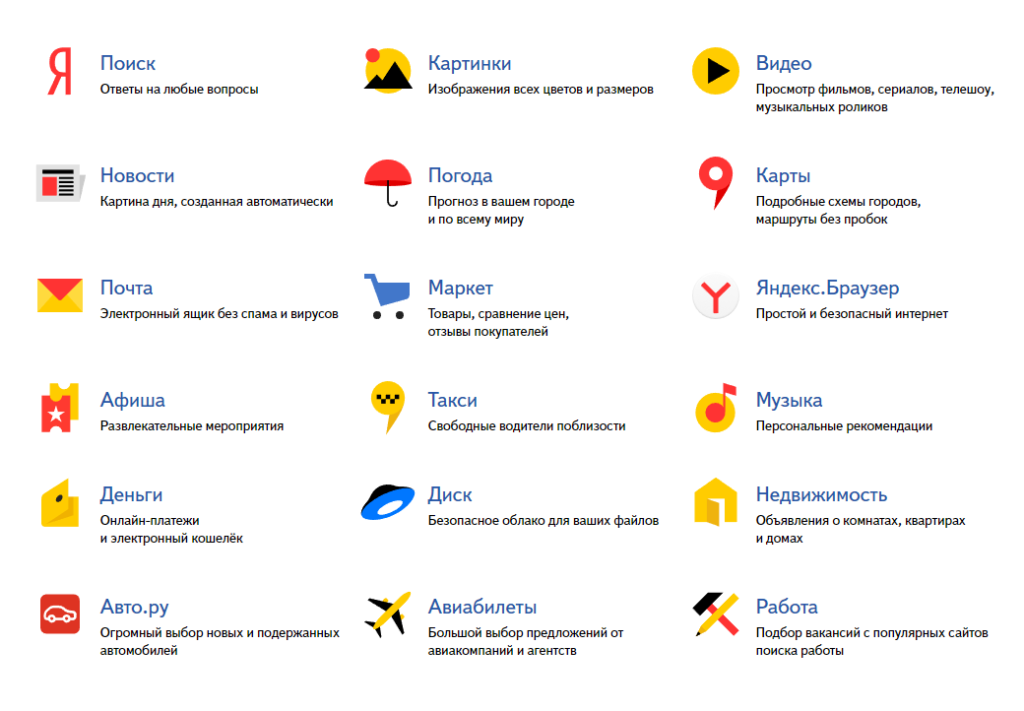

Яндекс Видео — бесплатный сервис поиска и просмотра видеороликов онлайн

Яндекс.Видео – сервис для поиска и просмотра видеороликов, разработанный компанией Яндекс. Смотреть видео онлайн можно сразу на странице результатов поиска в сервисе Яндекс.Видео. Поиск по видеороликам и каналам очень простой.

Сервис был создан 3 июля 2008 года как часть поиска Яндекса. До 2014 года пользователи могли не только искать и просматривать чужие видеоролики, но и загружать собственные. Однако компания решила оставить лишь поисковый функционал Яндекс.Видео.

С помощью Яндекс.Видео можно:

- Искать видеоролики,

- Смотреть популярные видеозаписи,

- Создавать подборки и коллекции видео,

- Делиться видеозаписями в социальных сетях.

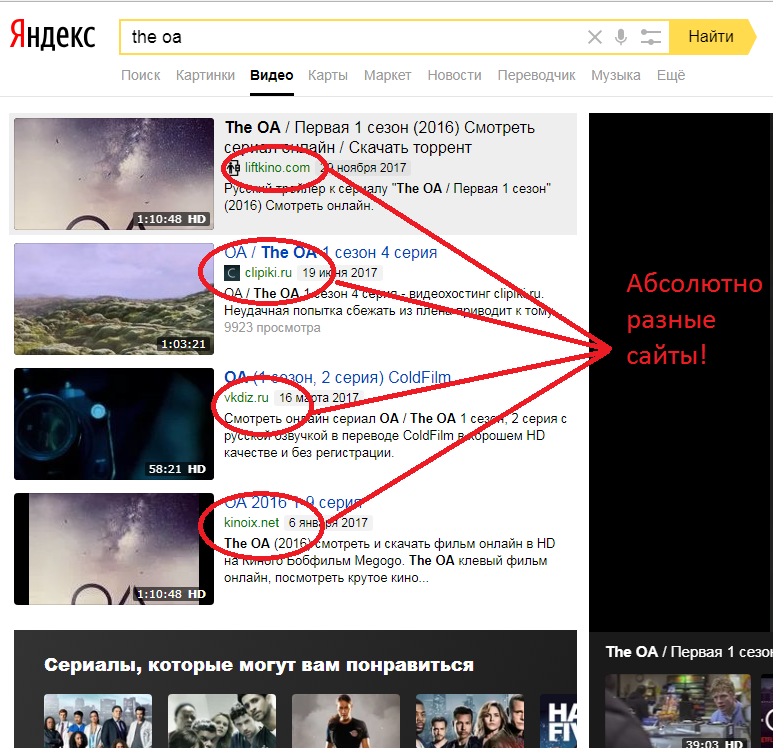

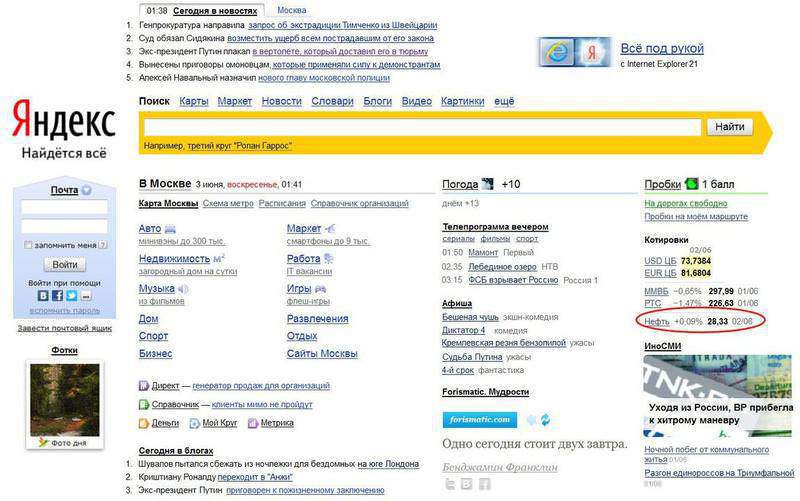

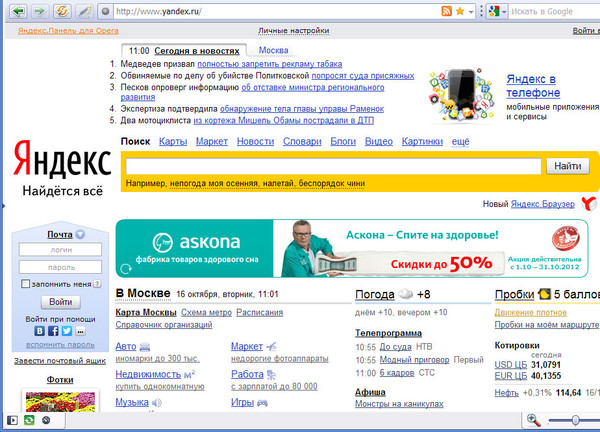

Когда мы задаем поисковый запрос в Яндексе, подходящим ответом на который будет видео, Яндекс обязательно добавит Яндекс. Видео в результаты поиска:

Видео в результаты поиска:

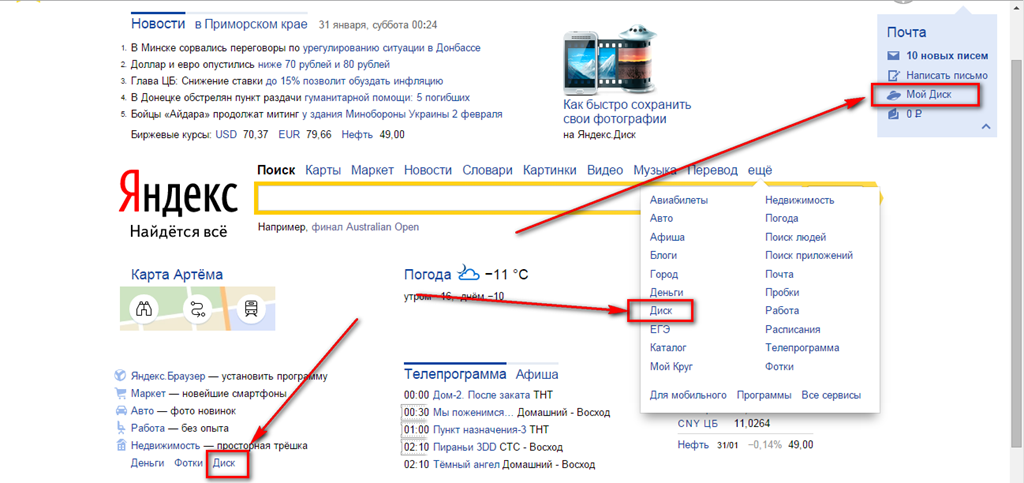

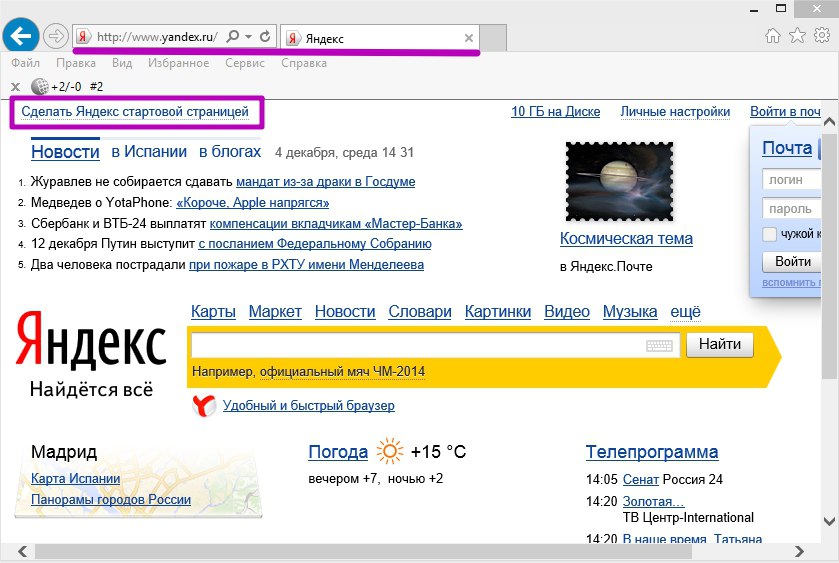

Даже если система не предложила блок с видео в результатах поиска, можно самостоятельно перейти в подборку Яндекс.Видео, кликнув на ссылку в меню под строкой поиска:

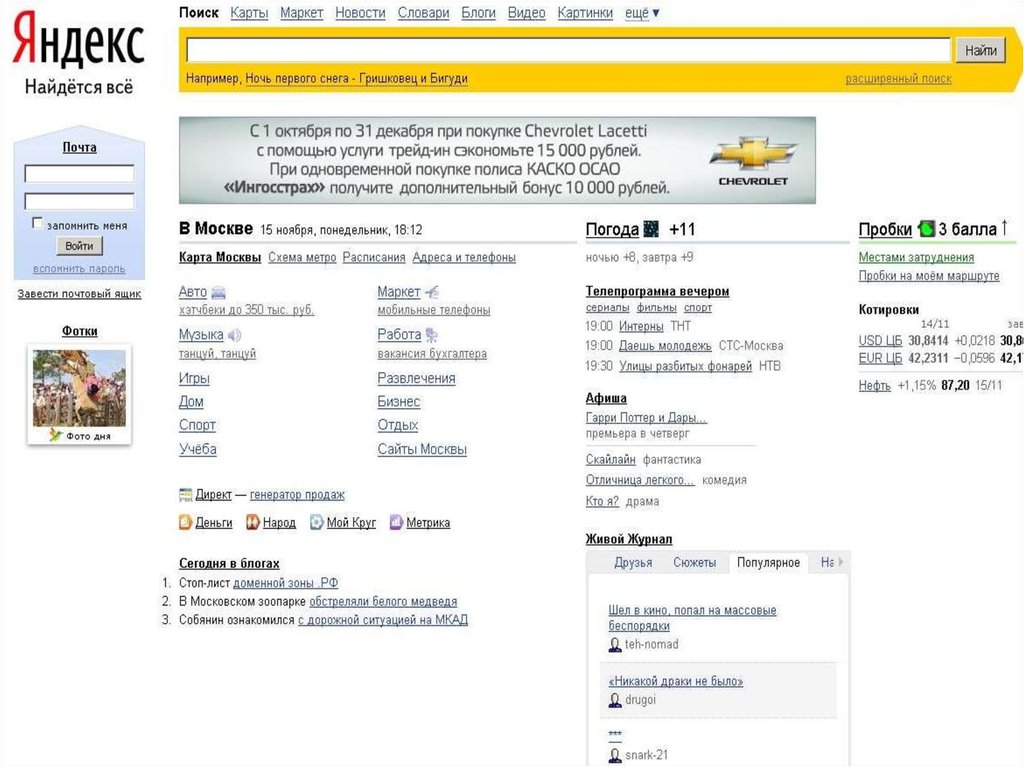

Яндекс.Видео: главная страницаПерейти в Яндекс.Видео можно со страницы yandex.ru:

Вот так выглядит главная страница сервиса: в левой части расположены популярные видео и быстрый фильтр по категориям видео, справа находится видеоплеер.

В низу страницы есть блок Популярные запросы пользователей сервиса.

Яндекс.Видео: поискКогда мы ищем что-то в поиске Яндекс.Видео, результаты поиска отображаются в левой части страницы, видеоплеер – по-прежнему справа. Такой функционал Яндекс.Видео позволяет смотреть ролики онлайн, быстро выбирая самый подходящий.

Для уточнения результатов поиска можно воспользоваться Расширенным поиском.

Также можно настроить режим поиска:

- Семейный — в результаты поиска не попадает видеоконтент «для взрослых».

- Умеренный — видео «для взрослых» попадает в поисковую выдачу, если запрос явно направлен на поиск таких ресурсов. Режим включен по умолчанию.

- Без защиты — режим фильтрации отключен.

Результаты поиска отображаются в левой части страницы обычным списком. Рядом с названием видео указана дата его загрузки на сайт, а также короткое описание и количество просмотров.

Как и в любой поисковой выдаче, в результатах поиска Яндекс.Видео есть реклама – видеоматериалы с сайтов-партнеров Рекламной cети Яндекса. Такие ролики не являются частью поисковой выдачи и не влияют на формирование результатов поиска. Они подбираются специальными алгоритмами, которые учитывают поисковые запросы пользователей. В результатах поиска рядом с ними стоит отметка «Видео партнера».

В результатах поиска Яндекс.Видео собраны видеоролики с разных видеохостингов и развлекательных сайтов. Видео можно смотреть как во встроенном плеере Яндекс.Видео (для этого нужно кликнуть по названию видеоролика или изображению слева от него) или перейти на сайт-источник (для этого нужно кликнуть на ссылку на сайт под названием видео).

Как работает встроенный плеер Яндекс.Видео

Итак, как только мы находим интересное видео в результатах поиска, кликаем по нему, и оно тут же начинает проигрываться в видеоплеере справа. Видеоплеер Яндекс.Видео устроен таким образом, что в окне изображения встроен плеер того сервиса, откуда проигрывается видео. Например:

- Видео с YouTube

- Видео с Одноклассников

- Видео с Mail.ru

Функционал плеера-источника при проигрывании в плеере Яндекс.Видео сохраняется. Например, в видео с YouTube можно не только менять качество изображения, но и включать/отключать субтитры. Качество видео в сервисе Яндекса зависит от сайта-источника.

Качество видео в сервисе Яндекса зависит от сайта-источника.

Из собственного функционала Яндекс.Видео в плеере есть следующее:

- кнопка Сохранить, клик на которую добавляет видео в раздел Мои видео (доступен только для авторизованных пользователей).

- кнопка Поделиться, позволяющая отправить видео в популярные социальные сети.

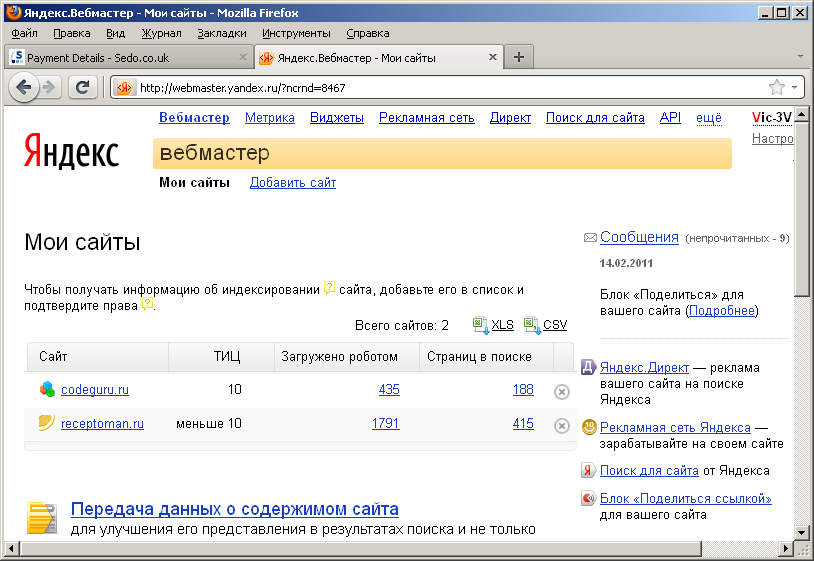

В 2014 году сервис убрал возможность загружать собственные видеоролики, сегодня Яндекс.Видео позволяет смотреть и искать видео, не более. Если пользователю очень хочется, чтобы его ролик отображался в Яндекс.Видео, он может загрузить его на любой видеохостинг, а затем дождаться индексации Яндексом.

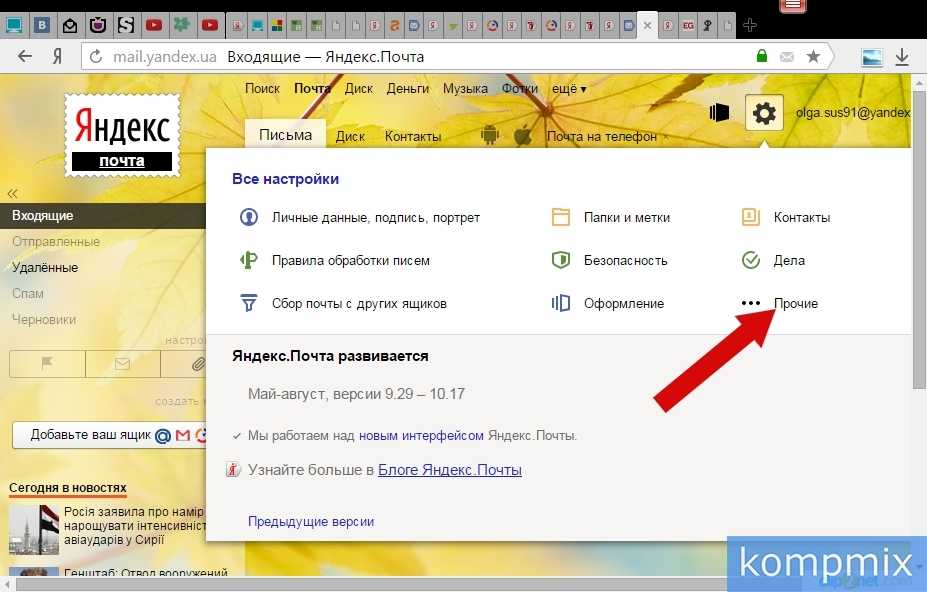

как работает и как его включить

Артем Мазанов

переведется все

Профиль автора

Нейросети «Яндекса» больше года переводят на русский язык и озвучивают видео. Они умеют различать разных спикеров в одном ролике и знают пять языков.

Они умеют различать разных спикеров в одном ролике и знают пять языков.

Прототип технологии машинного перевода видео и закадровой озвучки в реальном времени «Яндекс» представил в июле 2021 года. Тогда он работал только с отобранными видео на английском языке. Спустя полтора года эта функция — одна из самых полезных в «Яндекс-браузере». Технология позволяет переводить видео уже с пяти языков: английского, французского, испанского, немецкого и итальянского.

Расскажу, как активировать функцию, как она работает и какие проблемы пришлось преодолеть для создания качественной закадровой озвучки нейросетями.

Что вы узнаете из материала

- Зачем нужен закадровый перевод видео

- Как включить закадровый перевод видео

- Как включить перевод прямых трансляций

- Как именно нейросети переводят видео

- Как работает перевод прямых трансляций

Зачем нужен закадровый перевод видео

Контента на русском языке значительно меньше, чем на английском. В ноябре 2022 года во всем интернете насчитывалось больше 1,1 млрд сайтов. Из них на русском — меньше 10%. Англоязычных видео намного больше, чем русскоязычных.

В ноябре 2022 года во всем интернете насчитывалось больше 1,1 млрд сайтов. Из них на русском — меньше 10%. Англоязычных видео намного больше, чем русскоязычных.

На YouTube можно встретить целые проекты, которые занимаются озвучками иностранных роликов. Но это долго, много видео так не переведешь, к тому же переведенные ролики периодически удаляют за нарушение авторских прав. Англоязычные блогеры и образовательные проекты редко добавляют российскую озвучку — можно вспомнить разве что самого популярного ютубера в мире Mr.Beast. Закадровый перевод от «Яндекс-браузера» решает многие из этих проблем.

Не все даже знают, что на YouTube можно загружать несколько звуковых дорожекНекоторого полезного контента на русском языке нет вообще. Например, видеороликов, помогающих учиться, развиваться, решать рабочие и профессиональные задачи. Фотографы могут выбрать объектив после просмотра видео, а дизайнеры — графический планшет. Большинство обзоров техники сначала появляется как раз на английском языке.

Некоторые темы вообще трудно найти в русскоязычном сегменте YouTube. Я столкнулся с этим, когда искал сравнение двух фотоаппаратов моментальной печати Polaroid.

/list/youtube-classics/

Фейнман, Канеман и Ростропович: 13 образовательных плейлистов на «Ютубе»

Также в открытом доступе есть много уникального и полезного контента. Например, курсы или лекции от ведущих мировых университетов. Авторы редко переводят такие видео на русский язык. Обычно их можно смотреть максимум с субтитрами. Некоторые наиболее популярные лекции переводят энтузиасты. Но таких видео мало.

Помогает смотреть видео в фоновом режиме. На том же YouTube неплохо обстоит ситуация с субтитрами: они даже генерируются автоматически, в том числе и русскоязычные. Но так сложнее воспринимать видео на незнакомом языке во время готовки или занятий спортом.

К тому же, согласно исследованию Morning Consult, 86% опрошенных россиян предпочитают смотреть контент на стриминговых платформах в дубляже, а не с субтитрами или полностью в оригинале. Это самый высокий показатель среди 15 стран — участниц опроса.

Это самый высокий показатель среди 15 стран — участниц опроса.

/films-without-dubbing-pros-cons/

За и против: стоит ли смотреть фильмы и сериалы в оригинале

Как включить закадровый перевод видео

В «Яндекс-браузере» на компьютере. Работает сразу же на всех популярных площадках, включая YouTube, Vimeo, TikTok, Twitter, Facebook и «Вконтакте». Заходить на сайты не обязательно — ролики можно переводить прямо в поисковой выдаче. А недавно браузер научился делать закадровую озвучку для курсов на образовательной платформе Coursera.

Соцсеть Facebook принадлежит Meta — организации, деятельность которой признана экстремистской и запрещена на территории РФ

Для пользователя процесс выглядит очень просто. Достаточно открыть ролик в браузере и навести курсор на видео — сразу появится кнопка с предложением активировать озвучку. Сгенерированный перевод можно включать и выключать на любом отрезке видео.

Иконка быстро пропадает и не мешает смотреть видео. Источник: youtube.com

Источник: youtube.comТехнология приглушает оригинальную озвучку и поверх накладывает сгенерированную речь. Мужские голоса озвучиваются мужским голосом, женские — женским. Технология умеет распознавать нескольких спикеров на одном видео, у каждого из них будет свой голос озвучки, чтобы зрители не запутались.

В настройках, которые доступны рядом с иконкой перевода, можно регулировать громкость оригинальной дорожки и включить субтитры. Некоторые видео технология переводит сразу же, потому что другие пользователи переводили их раньше. Для перевода других роликов придется подождать несколько минут. Когда ролик с русской озвучкой будет готов к просмотру, пользователю придет уведомление.

/my-smart-house-with-alice/

Сам написал код и распечатал гаджеты на 3D-принтере: как я организовал работу умного дома

Примерное время перевода видео указывается в плеере. Если этой информации нет, то видео уже перевелосьПродолжительность выбранного видео не должна превышать четыре часа. Перевод работает только на платформах, где не требуется лицензирование контента. Например, перевести сериал на «Нетфликсе» не получится.

Перевод работает только на платформах, где не требуется лицензирование контента. Например, перевести сериал на «Нетфликсе» не получится.

В приложении «Яндекса» на смартфоне. Здесь все то же самое, что и на компьютере. Встроить закадровый перевод прямо в приложение YouTube нельзя, но ролик можно открыть в браузере «Яндекса».

Иконка с переводом появится сразу под видео, если пропадет — нажмите на ролик.

На смартфонах настроек меньше: например, нельзя регулировать громкость оригинальной дорожкиВ других браузерах на компьютере. Официально закадровый перевод «Яндекса» не поддерживается в других браузерах. Но есть неофициальные способы перенести функцию в Google Chrome или Safari.

Мы не приводим ссылки, так как скрипты разработаны третьими лицами — используйте на свой страх и риск.

Как включить перевод прямых трансляций

Перевод прямых трансляций запустили в августе 2022 года. Он работает в тестовом режиме: технология синхронного перевода и озвучки сложнее, чем в случае с готовыми роликами.

Переводить можно только стримы на некоторых ютуб-каналах. Например, запуски SpaceX и NASA, анонсы от Apple и выступления с конференций TED.

Для пользователя перевод прямых трансляций не отличается от перевода видео. Нужно нажать на ту же кнопку во всплывающем окне, и спикеры начнут разговаривать на русском языке.

Как именно нейросети переводят видео

Как именно работает технология и какие проблемы пришлось решать, мне рассказал руководитель перевода видео в «Яндекс-браузере» Сергей Корбан.

Когда началась работа над переводом видео, у браузера уже были нейросети, которые умеют переводить речь в текст и озвучивать текст с помощью синтеза речи. Они используются в других продуктах: например, голосовой помощник «Алиса» слушает человека и распознает его слова, а модуль для распознавания речи конвертирует слова в текст.

/yandex-station2-review/

Обзор «Яндекс-станции 2» с Алисой: пока что лучшей колонки для управления умным домом

Эти технологии и взяли за основу при разработке перевода видео. Но время работы над первой версией технологии команда столкнулась с некоторыми проблемами:

Но время работы над первой версией технологии команда столкнулась с некоторыми проблемами:

- Нейросети при переводе не очень хорошо улавливали контекст, поэтому их дополнительно обучали на корпусах текстов разных тематик. Первая версия лучше всего переводила экономические, литературные темы и научные статьи. Сейчас технология хорошо справляется с биологией и физикой, но с другими темами периодически возникают сложности, например с игровыми стримами — в них особенная лексика.

- Нейросети умели только определять пол спикера — и то не всегда. В новой версии технология уже может распознавать голоса разных спикеров в одном видео и их пол. Благодаря этому несколько спикеров одного пола озвучиваются разными голосами. Это голоса реальных людей, на которых нейросеть научилась синтезировать озвучку.

- Перевод нужно было уместить на ту же звуковую дорожку, что и оригинал. При этом длина одной и той же фразы, произнесенной на разных языках, может различаться. Например, в русском языке фразы обычно длиннее, чем в английском.

Чтобы озвучка попала в слова, нейросеть, которая отвечает за синтез речи, ускоряет или замедляет речь и делает паузы.

Чтобы озвучка попала в слова, нейросеть, которая отвечает за синтез речи, ускоряет или замедляет речь и делает паузы.

Все эти проблемы решены в текущей версии технологии перевода видео. За это отвечают сразу шесть нейросетей.

Первая нейросеть на стороне переводчика определяет язык спикеров. Если они говорят на языке, который поддерживается, браузер предложит перевести видео.

Вторая нейросеть переводит речь спикеров в текст. Модель получает аудиодорожку, из нее она должна вычистить все посторонние звуки. Модель умеет избавляться от слов-паразитов. После всех обработок остается последовательный набор слов — с ним будут работать другие нейросети.

/chatgpt/

Чат-нейросеть ChatGPT ведет диалог, пишет код и сочиняет стихи: как попробовать самому

Пример того, как нейросеть переводит речь в текст. Источник: «Яндекс»Третья нейросеть нормализует текст и расставляет знаки препинания. Нормализация — это преобразование текста в одну нормальную словарную форму.

Нормализация — это преобразование текста в одну нормальную словарную форму.

Например, расшифровка сокращений. На этом этапе последовательность слов также нарезается в предложения. При их составлении модель должна сохранить изначальный смысл.

Сверху показано, какой текст нейросеть получает на входе, а снизу — как она делает из этого набора слов предложения. Источник: «Яндекс»Четвертая нейросеть определяет, сколько спикеров на видео и какой у них голос — мужской или женский. Это нужно, чтобы на другом этапе каждому спикеру присвоить свой голос.

Определить пол можно по частоте голоса: у мужчин это 80—150 Гц, у женщин — 150—250 Гц. Также помогают и местоимения, которые произносит другой спикер.

Источник: «Яндекс»Пятая нейросеть переводит полученный текст на русский язык. Вместе с текстом модель получает информацию о спикерах, чтобы правильно расставить местоимения.

Шестая нейросеть синтезирует речь. На этом этапе нужно избежать рассинхрона, потому что перевод предложения может оказаться в несколько раз длиннее оригинала. Иногда помогают паузы спикеров, в эти моменты можно уложить перевод. Но иногда приходится ускорять речь.

Иногда помогают паузы спикеров, в эти моменты можно уложить перевод. Но иногда приходится ускорять речь.

Как работает перевод прямых трансляций

С точки зрения технологий перевод стрима и перевод записанного видео — две принципиально разные задачи. Перевод потоковых видео построен на другой архитектуре, но работает с теми же моделями.

Переводить потоковые видео сложнее. Нужно одновременно решать две противоречивые задачи — поддерживать качество перевода и не отставать от речи спикеров. При переводе обычных роликов нейросети получают аудиодорожку сразу целиком. У них есть время ее проанализировать, разбить речь на предложения и синтезировать озвучку на русском языке.

Во время работы с прямыми трансляциями такого запаса времени нет — технология работает почти как синхронный переводчик. Чтобы задержка в переводе была небольшой, на помощь приходит нейросеть, которая расставляет в тексте знаки препинания. Это помогает понять, где начинается и заканчивается предложение, найти составные части сложносочиненного предложения, вводные фразы, перечисления и так далее.

/video-support/

Какое видео вам нужно посмотреть прямо сейчас?

После того как знаки препинания расставлены, нейросеть выделяет из текста части, содержащие законченную мысль. Именно они отправляются на перевод, который затем синтезируется и накладывается поверх оригинальной аудиодорожки. Так браузер находит оптимальный баланс между скоростью перевода и его качеством.

Задержка перевода ютуб-трансляций составляет от 30 до 50 секунд. Также в переводе стримов пока используются только два голоса — мужской и женский. Поддержки мультивойса нет.

Что в итоге

- Перевод и закадровая озвучка видео в «Яндекс-браузере» — полезный инструмент для тех, кто плохо знает иностранные языки и не хочет смотреть видео с субтитрами, даже если они есть.

- Нейросеть генерирует закадровую озвучку для роликов на пяти языках и некоторых прямых трансляций на YouTube. Технология не только переводит речь, но и различает спикеров на видео, а также синтезирует разную озвучку для участников видео одного пола.

- Если смотреть на технологию изнутри, то озвучкой в «Яндекс-браузере» занимается не одна нейросеть, а целых шесть. Все они дополняют друг друга.

- Функция работает только в «Яндекс-браузере», но есть способы перенести ее в Chrome или Safari с помощью скрипта.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult.

Перевод прямых трансляций через Яндекс Браузер: Принципы и отличия от озвучивания видео по запросу | Сергей Дуканов | Яндекс

Мы уже рассказывали о том, как работает автоматический перевод и озвучивание видео в Яндекс Браузере. Пользователи просмотрели 81 миллион видеороликов с озвученным переводом за первые десять месяцев после релиза. Механизм работает по запросу: как только пользователь нажимает на кнопку, нейросеть получает всю звуковую дорожку, а дублированный перевод на язык пользователя появляется через несколько минут.

Но этот способ не подходит для прямых трансляций, где нужно переводить практически в реальном времени. Именно поэтому мы просто запустили отдельный, более сложный механизм трансляции прямых трансляций в Яндекс.Браузере. Анонсы устройств, спортивные соревнования, вдохновляющие космические запуски — все это и множество другого контента теперь можно смотреть на целевом языке в прямом эфире. Производственная версия в настоящее время поддерживает перевод только на русский язык, а английский язык появится этой осенью. Также на данный момент озвучка доступна для ограниченного набора потоков YouTube: полный список вы можете найти в конце этой статьи. В будущем мы, конечно же, откроем эту функцию для всех прямых трансляций YouTube. Нам пришлось перестраивать всю архитектуру с нуля, чтобы адаптировать механизм трансляции для потоков.

Именно поэтому мы просто запустили отдельный, более сложный механизм трансляции прямых трансляций в Яндекс.Браузере. Анонсы устройств, спортивные соревнования, вдохновляющие космические запуски — все это и множество другого контента теперь можно смотреть на целевом языке в прямом эфире. Производственная версия в настоящее время поддерживает перевод только на русский язык, а английский язык появится этой осенью. Также на данный момент озвучка доступна для ограниченного набора потоков YouTube: полный список вы можете найти в конце этой статьи. В будущем мы, конечно же, откроем эту функцию для всех прямых трансляций YouTube. Нам пришлось перестраивать всю архитектуру с нуля, чтобы адаптировать механизм трансляции для потоков.

С инженерной точки зрения перевод и дублирование прямых трансляций — сложная задача. Здесь сталкиваются два противоречивых требования. С одной стороны, вам нужно скормить модели как можно больше текста за раз, чтобы нейронная сеть понимала контекст каждой фразы. С другой стороны, необходимо минимизировать задержку; иначе «прямой эфир» перестанет быть таковым. Поэтому мы должны начать переводить как можно скорее: не в режиме настоящего синхронного перевода, но очень близко к нему.

С другой стороны, необходимо минимизировать задержку; иначе «прямой эфир» перестанет быть таковым. Поэтому мы должны начать переводить как можно скорее: не в режиме настоящего синхронного перевода, но очень близко к нему.

Мы разработали новую услугу на основе существующих алгоритмов для быстрого и качественного перевода и дублирования прямых трансляций. Новая архитектура позволила уменьшить задержку без потери качества.

Вкратце принцип работы прямой трансляции сводится к пяти моделям машинного обучения. Одна нейросеть отвечает за распознавание речи звуковой дорожки и преобразует ее в текст. Второй движок определяет пол говорящих. Третий разбивает текст на предложения, расставляя знаки препинания и определяя, какие части текста содержат законченные мысли. Четвертая нейросеть переводит полученные куски. Наконец, пятая модель синтезирует речь на целевом языке.

На бумаге все выглядит просто, но если копнуть глубже, можно обнаружить множество подводных камней. Давайте рассмотрим этот процесс более подробно.

На начальном этапе нужно точно понимать, о чем идет речь в эфире, и определить, когда произносятся слова. Мы не просто переводим речь, но и накладываем результат обратно на видео в нужные моменты.

Глубокое обучение — идеальное решение проблемы ASR (автоматического распознавания речи). Архитектура нейронной сети должна допускать сценарий использования прямой трансляции, когда необходимо обрабатывать звук по мере его поступления. Такое ограничение может повлиять на точность предсказания, но мы можем применить модель с некоторой задержкой (несколько секунд), что придает модели некоторый контекст.

Видео могут содержать посторонние шумы и музыку. Кроме того, люди могут иметь разную дикцию или говорить с разным акцентом и скоростью. Говорящих может быть много, и они могут кричать, а не говорить на умеренной громкости. И, конечно же, нужно поддерживать богатый словарный запас, ведь возможных тем видео очень много. Таким образом, сбор данных, необходимых для обучения, играет ключевую роль.

На вход алгоритм получает последовательность звуковых фрагментов, берет N из них с конца, извлекает акустические признаки (спектрограмму MEL) и подает результат на вход нейронной сети. Он, в свою очередь, выдает набор последовательностей слов (так называемых гипотез), из которых языковая модель — текстовая часть нейронной сети — выбирает наиболее правдоподобную гипотезу. Когда поступает новый фрагмент аудио, процесс повторяется.

Полученную последовательность слов необходимо перевести. Качество пострадает, если вы будете переводить слово за словом или фразу за фразой. Если вы дождетесь длинной паузы, означающей конец предложения, произойдет значительная задержка. Поэтому необходимо группировать слова в предложения, чтобы избежать потери смысла или слишком длинных предложений. Одним из способов решения этих проблем является использование модели восстановления пунктуации.

С появлением трансформеров нейронные сети стали намного лучше понимать смысл текста, отношения между словами и закономерности языковых конструкций. Вам нужен только большой объем данных. Для восстановления пунктуации достаточно взять корпус текстов, подать текст без знаков препинания на вход нейронной сети и научить сеть исправлять его обратно.

Вам нужен только большой объем данных. Для восстановления пунктуации достаточно взять корпус текстов, подать текст без знаков препинания на вход нейронной сети и научить сеть исправлять его обратно.

Текст поступает на вход нейросети в токенизированном виде; обычно это токены BPE. Такое разбиение не слишком мало, чтобы предотвратить удлинение последовательности, но и не слишком велико, чтобы избежать проблемы отсутствия словарного запаса, когда токен отсутствует в глоссарии. На выходе модели каждое слово имеет последующую метку, которая отмечает, какой знак препинания следует поставить.

Необходимо установить некоторый ограниченный контекст, чтобы обеспечить правильную работу в условиях прямой трансляции. Размер этого контекста должен найти компромисс между качеством и задержкой. Если мы не уверены, нужно ли разбивать предложения в данном конкретном месте, мы можем немного подождать, пока не появятся новые слова. Тогда мы либо лучше определим разбиение, либо превысим контекстный предел и будем вынуждены разбиваться там, где мы лишь немного конечно.

Для корректного перевода и качественного озвучивания необходимо определить пол говорящего. Если вы используете классификатор пола на уровне предложения, в сценарии прямой трансляции не будет различий по сравнению со сценарием по запросу. Хранение истории голосовых линий каждого говорящего помогает нам более точно классифицировать половую принадлежность. Это снижает количество ошибок в полтора раза. Мы не только можем определить пол человека всего по одной фразе, но и рассматриваем результаты гендерной классификации по фразам, произнесенным ранее. Для этого нам нужно на лету определить, кому принадлежит линия, тем самым уточнив пол говорящего.

С точки зрения машинного перевода ничего не изменилось по сравнению с переводом готовых видео, поэтому сейчас не будем в это углубляться. В прошлом мы рассмотрели внутреннюю работу перевода.

Базовая технология синтеза в Алисе, умном помощнике Яндекса, аналогична той, которую мы используем в видеопереводе. Разница в том, как осуществляется применение (вывод) этих нейронных сетей. Говорящий в ролике может очень быстро произнести реплику, либо перевод предложения может получиться в два раза длиннее оригинала. В этих случаях вам придется сжимать синтезированный звук, чтобы не отставать от времени. Этого можно добиться двумя способами: на уровне звуковой волны, например, с помощью PSOLA (Pitch Synchronous Overlap and Add) или внутри нейронной сети. Второй метод обеспечивает более естественное звучание речи, но требует возможности редактирования скрытых параметров.

Говорящий в ролике может очень быстро произнести реплику, либо перевод предложения может получиться в два раза длиннее оригинала. В этих случаях вам придется сжимать синтезированный звук, чтобы не отставать от времени. Этого можно добиться двумя способами: на уровне звуковой волны, например, с помощью PSOLA (Pitch Synchronous Overlap and Add) или внутри нейронной сети. Второй метод обеспечивает более естественное звучание речи, но требует возможности редактирования скрытых параметров.

Важно не только доводить длительности синтезируемых фраз до нужной длины, но и разлагать их в нужные моменты. Не всегда будет идеально: придется либо ускорять запись, либо сдвигать тайминги — за это отвечает алгоритм стекирования. В прямом эфире нельзя изменить прошлое, поэтому может возникнуть ситуация, когда нужно озвучить фразу в два раза быстрее, чем она произносится в исходном видео. Для справки: ускорение более чем на 30% существенно влияет на человеческое восприятие.

Решение следующее: резервируем время заранее. Мы не торопимся складывать голосовые линии и можем дождаться новых, чтобы учесть их продолжительность. Мы также можем позволить накапливаться небольшому временному сдвигу, поскольку рано или поздно в видео будет несколько секунд тишины, и сдвиг будет сброшен до нуля.

Мы не торопимся складывать голосовые линии и можем дождаться новых, чтобы учесть их продолжительность. Мы также можем позволить накапливаться небольшому временному сдвигу, поскольку рано или поздно в видео будет несколько секунд тишины, и сдвиг будет сброшен до нуля.

Полученная звуковая дорожка разрезается на фрагменты и оборачивается аудиопотоком, который будет микшироваться локально в самом Браузер-клиенте.

При просмотре трансляции Браузер опрашивает стриминговый сервис (например, YouTube) на наличие новых фрагментов видео и аудио; если они есть, он загружает и воспроизводит их последовательно.

Когда пользователь нажимает на кнопку живого перевода, Яндекс.Браузер запрашивает ссылку на поток с переведенным звуком из своего бэкенда. Браузер накладывает этот трек поверх основного, соблюдая тайминги.

В отличие от готовых видео, прямая трансляция обрабатывается машинным переводом каждый момент своего существования. Stream Downloader считывает аудиопоток и отправляет его в конвейер обработки ML, компоненты которого мы разобрали выше.

Существует несколько способов организации взаимодействия между компонентами. Мы остановились на варианте с очередями сообщений, где каждый компонент оформлен как отдельный сервис:

- Запустить все модели на одной машине проблематично: они могут просто не помещаться в памяти или требовать очень специфической аппаратной конфигурации.

- Требуется для балансировки нагрузки и возможности горизонтального масштабирования. Например, сервисы машинного перевода и синтеза голоса имеют разную пропускную способность, поэтому количество фраз может отличаться.

- Службы иногда аварийно завершают работу (графическому процессору не хватает памяти, утечке памяти или отключению электроэнергии в центре обработки данных), а очереди предоставляют механизм повторных попыток.

Поток не привязан к одному экземпляру, но для обработки может потребоваться некоторый контекст (фон). Например, синтезатору необходимо хранить записи, которые еще не были помещены на окончательную звуковую дорожку. Следовательно, необходим глобальный репозиторий контекста для всех потоков. На схеме он обозначен как Global Context — по сути, это просто хранилище ключ-значение в памяти.

Следовательно, необходим глобальный репозиторий контекста для всех потоков. На схеме он обозначен как Global Context — по сути, это просто хранилище ключ-значение в памяти.

Наконец, полученный аудиопоток должен быть доставлен пользователю. Здесь за дело берется Stream Sender: он оборачивает аудиофрагменты в потоковый протокол, а клиент читает этот поток по ссылке.

В настоящее время мы предоставляем прямую трансляцию со средней задержкой 30–50 секунд. Иногда мы вылетаем из этого диапазона, но ненамного: стандартное отклонение около 5 секунд.

Основная трудность при переводе прямых трансляций заключается в обеспечении того, чтобы задержка не колебалась слишком сильно. Простой пример: вы открываете прямую трансляцию и через 15 секунд начинаете получать трансляцию. Если вы продолжите смотреть, рано или поздно одной из моделей понадобится больше контекста — например, если говорящий произносит длинное предложение без пауз, нейронный движок попытается получить его целиком. Тогда задержка увеличится, возможно, еще на десять секунд. Естественно, предпочтительна небольшая задержка в начале, чтобы этого не произошло.

Тогда задержка увеличится, возможно, еще на десять секунд. Естественно, предпочтительна небольшая задержка в начале, чтобы этого не произошло.

Наша глобальная цель — сократить задержку примерно до 15 секунд. Это немного больше, чем в настоящем синхронном переводе, но достаточно для прямых трансляций, где ведущие взаимодействуют с аудиторией, например, на Twitch.

Пока полный доступ ко всем трансляциям YouTube находится в разработке, вот список каналов, где дублирование уже доступно:

— Apple

— Business Insider

— CNET Highlights

— English Speeches

— Freenvesting

— thegameawards

— Google Developers

— IGN

— NASA

— The Overlap

— SpaceX

— TechCrunch

— TED

— TEDx

Классификация видео — Учебники | Документация Толока

Из этого туториала вы узнаете, как запустить классификацию видео в Толоке. Мы будем использовать предустановку проекта, разработанную специально для этого типа маркировки данных.

Классификация видео — это тип задачи маркировки данных с видеоплеером и несколькими вариантами ответов. Толокер просматривает видеоролик и выбирает один из предложенных вариантов ответа.

Вы можете использовать этот тип проекта для:

Модерация контента.

Сортировка видеоклипов по заданным категориям.

Рейтинг видеоклипов на основе того, насколько они нравятся Толокерам.

Обнаружение шумов и других визуальных дефектов в видео.

Предварительные условия

Прежде чем начать:

Убедитесь, что вы зарегистрированы в Толоке как запрашивающий.

Пополнить счет в Толоке. Если вы не уверены в бюджете, вы можете сделать это позже в этом руководстве. Толока покажет смету бюджета вашего проекта.

Загрузите свои видеоклипы в хранилище, из которого вы можете получить ссылки на файлы. Например, собственный сервер, видеохостинг или облачное хранилище.

Ограничение

Видеоплеер поддерживает только формат MP4 с кодировкой H.264 или H.265.

Убедитесь, что ролики выглядят одинаково в десктопной и мобильной версии Толоки. Видеоклип может не воспроизводиться или воспроизводиться некорректно в мобильной версии. В этом случае при создании пула вам нужно будет ограничить доступ к пулу для Толокеров с мобильных устройств.

Подробнее о настройке задач для мобильных устройств.

Выберите предустановку

Мы рекомендуем начать с предустановки проекта, чтобы упростить настройку и получить лучшие результаты.

Перейдите по этой ссылке или создайте проект вручную:

В главном меню выберите вкладку Проекты и нажмите Создать проект .

Выберите предустановку Классификация жестов рук .

Нажмите Выберите этот пресет во всплывающей вкладке.

Создать проект

Настройте, как будут выглядеть ваши задачи для Толокеров. Толокеры — это люди по всему миру, которым платят за выполнение ваших заданий.

В разделе Общая информация добавьте имя и описание проекта.

Название для показа Толокеры : В 2-5 словах изложите общую идею проекта.

Описание для Толокеров : В паре предложений объясните, чего вы ожидаете от Толокеров. Это просто обзор. Инструкцию напишешь потом.

В разделе Интерфейс задач настройте, как будут выглядеть ваши задачи. Этот пресет имеет предварительно настроенный шаблон задачи с проверкой, сочетаниями клавиш и макетом задачи.

В этом руководстве используется Конструктор шаблонов, но для той же цели можно использовать редактор HTML/JS/CSS.

Используя визуальный редактор , добавьте свои данные в раздел Config :

Вопрос, который толокеры увидят в вашем задании : Напишите вопрос, который соответствует ответам, из которых толокеры должны выбрать.

Все задачи в проекте используют один и тот же вопрос.

Все задачи в проекте используют один и тот же вопрос.Вставить ссылку на образец видео : Это видео используется только для предварительного просмотра интерфейса задачи справа.

Задать варианты ответа предварительно заполнен образцами ответов. Замените образцы своими категориями. Обратите внимание, что Other и Error являются отдельными объектами.

Если вы используете видео с YouTube

Необработанные данные задачи хранятся в формате XSLX, TSV или JSON. Результаты маркировки представлены в файле TSV. Раздел Спецификация данных определяет, какие параметры могут содержаться в этих файлах.

Нажмите Показать спецификации и проверить значения:

Входные данные и Выходные данные соответствуют интерфейсу задачи, установленному в Конструкторе шаблонов .

Убедитесь, что есть поля для всех типов данных, которые вы используете для своих задач, и для тех, которые вы хотите видеть в файле результатов.

Убедитесь, что есть поля для всех типов данных, которые вы используете для своих задач, и для тех, которые вы хотите видеть в файле результатов.

В разделе Инструкции для толокеров добавьте инструкции, которые толокеры увидят, когда начнут выполнять ваши задачи. В инструкции можно добавлять текст, таблицы и изображения.

Проверьте образец текста инструкций и обновите его в соответствии с вашим проектом.

При написании инструкций помните, что большинство толокеров заранее ничего не знают о ваших задачах. Убедитесь, что ваши инструкции максимально ясны, но не слишком многословны. Для успешной маркировки данных постарайтесь найти баланс между охватом всего необходимого и краткостью. Узнайте больше в нашей базе знаний.

Чтобы сохранить данные и продолжить, нажмите Создать проект .

Создать пул

Пул — это набор задач, отправляемых Толокерам одновременно. В одном проекте может быть много пулов. При создании пула вы настраиваете ценообразование, фильтры аудитории для Толокеров и контроль качества.

В одном проекте может быть много пулов. При создании пула вы настраиваете ценообразование, фильтры аудитории для Толокеров и контроль качества.

Нажмите Добавить пул на странице проекта.

Выберите значение в раскрывающемся списке Тип пула .

Типы пулов

Если цена за набор задач равна нулю, необходимо выбрать тип пула.

Задайте Имя пула (видно только вам) поле. Только вы будете видеть это название пула на странице проекта.

Укажите описание пула, которое будет отображаться вместо описания проекта в списке задач для Толокеров. По умолчанию толокеры видят описание из настроек проекта. Чтобы использовать другое описание, снимите флажок Использовать описание проекта и установите Общедоступное описание . При необходимости нажмите + Личный комментарий , чтобы добавить описание частного проекта, которое будете видеть только вы.

Щелкните Создать .

На шаге Выберите аудиторию для вашей задачи настройте фильтры для выбора Толокеров для вашего пула.

Очистить Мои задачи могут содержать шокирующий или порнографический контент если в вашем проекте их нет.

Чтобы выбрать толокеров по языку, местоположению, возрасту, полу и другим параметрам, нажмите кнопку Кнопка Добавить фильтр .

Задания в пулах будут автоматически доступны в веб-версии Толоки и мобильном приложении. Если вы хотите изменить настройки по умолчанию и ограничить видимость задачи для любой из версий, добавьте фильтр Клиент и выберите нужное значение: Толока веб-версия или Толока для мобильных .

Используйте ползунок Баланс скорости/качества , чтобы изменить количество Толокеров, которые могут видеть ваши задачи.

Переместите ползунок вправо, чтобы исключить из участия в вашем проекте Толокеров с более низким рейтингом.

Переместите ползунок вправо, чтобы исключить из участия в вашем проекте Толокеров с более низким рейтингом.

На шаге Настройка контроля качества установите правила контроля качества для получения более точных результатов:

Сохранить предварительно настроенные правила контроля качества как есть: Толокеры, которые слишком быстро выполняют задания. Настройки по умолчанию означают, что Толокеры блокируются на проекте на 1 день, если они отвечают на 4 из 5 заданий менее чем за 15 секунд.

Большинство голосов : Это правило принимает самый популярный ответ как правильный и позволяет отфильтровывать Толокеров, которые отвечают неправильно. Настройки по умолчанию означают, что Толокеры, давшие правильные ответы менее чем на 40% заданий, блокируются на проекте на 1 день. Принять как большинство установить на

2означает, что 2 одинаковых ответа из всех ответов, данных на одно задание, будут считаться правильным ответом.

Чтобы отфильтровать Толокеров, которые часто ошибаются в контрольных заданиях, нажмите Добавить правило контроля качества → Контрольные задачи . Введите следующие значения:

Это означает, что если Толокер выполнил более трех контрольных заданий и дал неверные ответы более чем в 60% из них, он будет заблокирован и не сможет выполнять задания по данному проекту в течение 10 дней. .

Правило сработает, если вы укажете правильные ответы на контрольные задания. Вы сделаете это позже в этом уроке.

На Установить цену задания и перекрытие 9Шаг 0152, установите, сколько будет стоить вам одна задача.

В Цена за набор задач установите сумму денег, которую нужно заплатить за набор задач, выполненных одним Толокером. Набор задач — это страница с набором задач. Он может содержать одну или несколько задач. Если задачи простые, можно добавить 10–20 задач на комплект.

В поле Overlap укажите, сколько Толокеров должно выполнять каждую задачу.

Значение по умолчанию (

3) означает, что каждая задача будет иметь 3 ответа.

На шаге Добавить необязательные параметры пула укажите Время на набор задач, сек .

Этого времени должно хватить на чтение инструкции, загрузку задания, просмотр видеороликов и ответ (например, 1200 секунд).

На шаге Подготовка и загрузка данных загрузите данные задачи.

Прикрепите подготовленный набор данных или медиафайлы.

Чтобы скачать шаблон, нажмите одну из кнопок:

- Шаблон в формате XLSX

- Шаблон в формате TSV

- Шаблон в формате JSON

Для данного типа проекта файл с заданиями должен иметь один параметр. Его имя равно

INPUT:video, а значения — ссылки на видеоклипы.

ВХОД:видео

Откройте загруженный файл и замените ссылки на образцы ссылками на ваши видеоролики.

Нажмите Выберите подготовленный набор данных и загрузите только что созданный файл.

Щелкните Продолжить .

Толокерам в сюитах показаны задания. Набор — это одна страница с несколькими задачами. Определите, сколько задач включить в набор:

Общие задания : Это задания для толокеров.

Контрольные задачи : Это задачи с предопределенными ответами, используемые для контроля качества ответов. Вы создадите их на следующем шаге.

Тренировочные задания : Это задания с предопределенными ответами и пояснениями для Толокеров.

Обычно вы используете тренировочные задачи в отдельных тренировочных пулах. Вам не нужно включать их.

Обычно вы используете тренировочные задачи в отдельных тренировочных пулах. Вам не нужно включать их.

Например, вы можете добавить 9 общих задач и 1 контрольную задачу на набор:

Нажмите Объединить задачи в наборы .

Создать контрольные задачи на шаге Добавить контрольные задачи для проверки производительности . Для этого добавьте правильные ответы к некоторым вашим заданиям.

Установите флажок результат и выберите правильный ответ для задания. Затем нажмите кнопку Сохранить и перейти к следующей кнопке . Таким образом добавьте несколько контрольных задач.

Для больших пулов (более 1000 задач) рекомендуется добавлять в пул не менее 1% контрольных задач. Для небольших пулов (около 100 задач) нужно 10% контрольных задач.

Обратите внимание на график Распределение правильных ответов на контрольные задания в правой части страницы.

Он показывает, сколько контрольных задач каждого типа у вас есть. Мы рекомендуем добавлять равное количество каждого правильного ответа.

Он показывает, сколько контрольных задач каждого типа у вас есть. Мы рекомендуем добавлять равное количество каждого правильного ответа.

На Дважды проверьте свой проект и попробуйте задания 9На шаге 0152 проверьте, как будет выглядеть задание с точки зрения Толокера.

Этот шаг будет включен после выполнения предыдущих шагов. Вы можете пропустить этот шаг, нажав Сделать позже .

После всех шагов вы увидите, что настройка завершена, и ваш пул готов к маркировке наконечника на странице пула.

Начать маркировку

Убедитесь, что вы пополнили свой счет.

Чтобы отправить задания Толокерам и начать процесс маркировки, нажмите Начать маркировку .

Во всплывающей панели просмотрите бюджет и нажмите Запустить .

Посмотреть результаты

Ход маркировки можно посмотреть на странице пула.

Чтобы озвучка попала в слова, нейросеть, которая отвечает за синтез речи, ускоряет или замедляет речь и делает паузы.

Чтобы озвучка попала в слова, нейросеть, которая отвечает за синтез речи, ускоряет или замедляет речь и делает паузы.

Все задачи в проекте используют один и тот же вопрос.

Все задачи в проекте используют один и тот же вопрос. Убедитесь, что есть поля для всех типов данных, которые вы используете для своих задач, и для тех, которые вы хотите видеть в файле результатов.

Убедитесь, что есть поля для всех типов данных, которые вы используете для своих задач, и для тех, которые вы хотите видеть в файле результатов.

Переместите ползунок вправо, чтобы исключить из участия в вашем проекте Толокеров с более низким рейтингом.

Переместите ползунок вправо, чтобы исключить из участия в вашем проекте Толокеров с более низким рейтингом.

Обычно вы используете тренировочные задачи в отдельных тренировочных пулах. Вам не нужно включать их.

Обычно вы используете тренировочные задачи в отдельных тренировочных пулах. Вам не нужно включать их. Он показывает, сколько контрольных задач каждого типа у вас есть. Мы рекомендуем добавлять равное количество каждого правильного ответа.

Он показывает, сколько контрольных задач каждого типа у вас есть. Мы рекомендуем добавлять равное количество каждого правильного ответа.